Künstliche Intelligenz (KI-Systeme) und ihre Folgen ChatGPT - wird diese KI die Welt verändern?

Juro, ich würde mein Gehirn als eine Art Lernmaschine bezeichnen.

Nicht nur, aber auch.

Es ist darauf programmiert, immer neues lernen zu wollen.

Es kommt nie an ein Ende.

Vielleicht ist nicht jedes Gehirn so gepolt. Aber alleine bin ich damit auch nicht.

Es hört auch nach 72 Jahren nicht damit auf.

Das ist der Grund, warum ich mich mit dieser KI überhaupt befasse.

GTP ist für mein Gehirn etwas völlig neues.

Danach verlangt es. Es muss also auch " gefüttert " werden.

Zur Empathie muss ich sagen, dass es sich dabei um etwas sehr komplexes bei dem Menschen handelt.

Es gibt nicht nur die eine Form der Empathie, sondern viele Formen und Unterformen.

Habe zur Zeit wenig Zeit. Wenn mehr da ist, schreibe ich auch mehr darüber.

Aber im Grunde genommen könnte jeder sich da seine Gedanken machen.

Anna

Liebe @wurzelfluegel,

Lernfähigkeit einzuschränken, darin sehe ich keinen Sinn. Künstliche Intelligenz (KI) schließt schon per Definition Lernfähigkeit ein.

@hobbyradler

Die Selbstauskunft der KI kann stimmen, oder auch nicht.

Wer die KI nicht programmiert hat kann das nicht wissen, sondern nur glauben,

denn überprüfbar sind die Aussagen der KI über sich selbst, nur für einen verschwindend kleinen Teil der Menschen, auch wenn das was sie schreibt plausibel klingt.

Und manchmal frage ich mich auch: Wie wirken sich Programmierungsfehler aus? Sind in einer komplexen KI alle Programmierungsfehler zu finden und korrigierbar? Programmierer sind auch nur Menschen.

WurzelFluegel

Die Wirtschaftsbetriebe unserer Stadt haben nun auch eine KI eingesetzt, um die effektivsten Routen für die Enleerung der Restmülltonnen errechnen zu lassen. Wir haben etliche Neubaugebiete und dadurch war eine Neuberechnung der Routen notwendig. In unserer Straße wird nun die Leerung der Restmülltonne ab der kommenden Woche zwei Tage später stattfinden, statt dienstags nun donnerstags. Für solche Aufgaben ist eine KI also auch geeignet.

Drachenmutter

PS. Mich würde jetzt interessieren, in wieviel Straßen sich der Leerungstermin ändert. Leider stand das nicht im Info-Brief dabei.

.................................Hervorgehoben (bold) von mir

Mein großes Problem mit KI ist, dass ich Intelligenz weitgehend von den verfolgten Zielen als entkoppelt ansehe. Es gibt biologische Subjekte, die hoch intelligent sind, aber kriminelle Ziele verfolgen. Könnte das auch für maschinelle Subjekte gelten? Ich kann es nicht ausschließen.

Karl

Hallo @Karl

Das ist natürlich möglich, doch nur wenn es ihre Entwickler so wollen oder einen Fehler gemacht haben. Es war aber noch nie anders, bereits seit der Zeit als die IT noch DV genannt wurde.

Wenn eine KI kriminelle Ziele verfolgt ist es nicht ihr anzulasten sondern ihren Entwicklern.

Wir können uns sicherlich einigen, dass die tote, trotzdem extrem wichtige Hardware keine Intelligenz besitzt. Auch ein Bagger besitzt keine Intelligenz.

Die Intelligenz kann somit nur in der Software stecken. Selbst wenn sich die KI zusätzliche Software basteln würde, was keinerlei Problem ist, wäre dies allerdings von den Entwicklern veranlasst.

Einer KI kann niemals die Schuld gegeben werden.

Ciao

Hobbyradler

Lieber @Hobbyradler,

wir beide drehen uns im Kreis. Auch die Hardware unseres biologischen Gehirns besitzt keine Intelligenz, Informationsverarbeitung muss stattfinden, die "Software" also laufen, das neuronale Netz funktionieren.

Auch unser Entwickler, die Evolution während Millionen von Jahren, hat dafür gesorgt, dass wir lernen können.

ChatGPT macht übrigens einen Denkfehler, wenn sie sagt "ich als KI". das klingt so als wenn sie bereits das Ende der Entwicklung wäre, das ist ChatGPT aber nicht.

Ich erinnere Diskussionen mit Dir als wir darum stritten, ob eine Maschine je den Turing Test bestehen könnte. Jetzt sind wir sehr, sehr nahe dran - oder siehst Du das anders?

ChatGPT besteht den Turing-Test

Karl

Nun ChatGTP hat noch keinen eigenen Körper mit Sensoren und Aktoren, er/sie muss also mit Daten gefüttert werden, kann noch nicht selber hinaus in die Welt gehen.

Kommt aber bald.

Karl

@hobbyradlerVolle Zustimmung @Wurzelfluegel mit einer Ausnahme:

Die Selbstauskunft der KI kann stimmen, oder auch nicht.

Wer die KI nicht programmiert hat kann das nicht wissen, sondern nur glauben,

denn überprüfbar sind die Aussagen der KI über sich selbst, nur für einen verschwindend kleinen Teil der Menschen, auch wenn das was sie schreibt plausibel klingt.

Und manchmal frage ich mich auch: Wie wirken sich Programmierungsfehler aus? Sind in einer komplexen KI alle Programmierungsfehler zu finden und korrigierbar? Programmierer sind auch nur Menschen.

WurzelFluegel

Nicht alle Programmierer sind heutzutage Menschen.

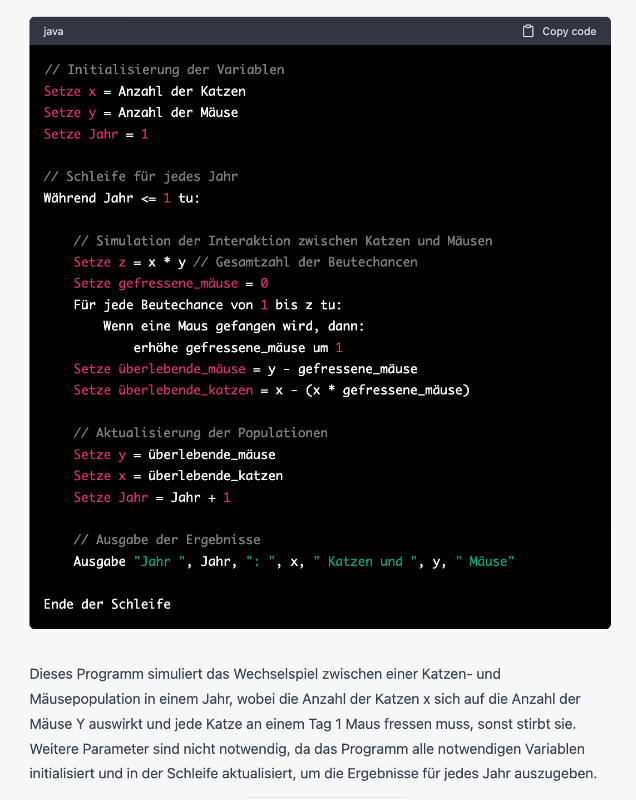

Meine Aufgabe für ChatGPT

Schreibe ein kurzes Computerprogramm in Basics, um das Wechselspiel zwischen einer Katzen- und Mäusepopulation in einem Jahr zu beschreiben, wenn die Anzahl der Katzen x sich auf die Anzahl der Mäuse Y auswirkt und jede Katze an einem Tag 1 Maus fressen muss, sonst stirbt sie. Brauchst Du noch mehr Parameter?

Antwort von ChatGPT

Da ich den genauen Basic-Dialekt nicht kenne, werde ich ein allgemeines Pseudocode-Programm zur Beschreibung des Wechselspiels zwischen einer Katzen- und Mäusepopulation in einem Jahr schreiben:

javaCopy code

--------------

--------------Ich habe das Programm jetzt nicht getestet (typischer Weise oszillieren die Populationsgrößen von Räuber und Beute), aber grundsätzlich kann ChatGPT programmieren. Wir sind nicht weit von dem Tag entfernt, an dem KIs ihren eigenen Code modifizieren.

Das wäre so als würden wir unsere DNA editieren können (was grundsätzlich geht, aber ein mühsamer Prozess wäre und nicht schritthalten könnte mit der Veränderung von Computercode).

Karl

Karl, noch mal

der Mensch oder Teile von ihm sind keine Maschine.

Wenn du Neurobiologe bist, wird es zu deiner wissenschaftlichen Grundausstattung gehören, dass die Informationswissenschaft die biologischen neuronalen Vorgänge zu modellieren und nachzuahmen versucht. Du schreibst ja selbst:

Biologische Gehirne werden informationstheoretisch betrachtet und physikalisch-technisch nachgestellt, modelliert.Als Neurobiologe habe ich erlebt, wie biologische Gehirne zunehmend informationstheoretisch betrachtet werden und andererseits konnte ich beobachten, wie erfolgreich künstliche neuronale Netze elementare Gehirnfunktionen nachahmten.

Das ist doch vom Denkansatz nichts anderes, als es mit der Bionik begonnen wurde. Die Gleichsetzung des Modells mit dem Original ist falsch. Die Imitation bleibt eine Imitation.

Sie muss uns helfen, als Menschen besser zu werden. Sie muss unser globales Wissen umfassender und schneller verfügbar machen für unsere Entscheidungsprozesse. Sie darf uns aber nicht überflüssig machen.

Mit globalem Wissen meine ich nicht nur das digitalisierte und maschinenlesbare Wissen, sondern alles Wissen, Erfahrungen, Traditionen, Weltanschauungen, Gefühle - nationale und individuelle aller Völker und Individuen.

Eine KI hat Berechnungen, kein individuell erlebtes Gewissen, kein Schuldgefühl, kann das Weinen eines in einem Krieg sterbenden Kindes nicht in seine Gefühlswelt aufnehmen und daraus eine vollkommene Umpolung seines bisherigen "Schlussfolgerns", Denken will ich dazu nicht sagen, bewirken.

Ich möchte dir empfehlen, dich mit dem Leben Ashokas, eines indischen Fürsten, zu beschäftigen. Er war der Legende nach ein großer Kriegsheld seines Volkes und hat am Ende dieser Laufbahn in einer Nacht ein ganzes Volk ausgelöscht. Als er am nächsten Tag die Leichen sah, seine Männer, aber auch die Männer, Frauen, Kinder und Alten des vernichteten Volkes, überkam ihn Angst vor sich selbst. Davor, dass er seine Seele so verunreinigt hatte, dass sie nur noch verbrannt werden würde und aus dem Kreislauf der Wiedergeburten gelöscht wird. Er wandte sich dem Buddhismus zu und versuchte Wiedergutmachung. Und jetzt darfst du nach den Gesetzen Ashokas suchen, falls du sie nicht schon kennst.

Juro

Hallo Hobbyradler,

du hast die richtigen Fragen gestellt !!!! Danke.

Juro