Künstliche Intelligenz (KI-Systeme) und ihre Folgen ChatGPT - wird diese KI die Welt verändern?

Lieber @der-waldler,

Wir befinden uns derzeit kurz vor der "Singularität", es kann einem schon jetzt schwindelig werden.

Karl

Verstehe ich nicht. Magst Du mal kurz erklären, Karl?

LG

ich beziehe mich hier auf das Buch von Ray Kurzweil, das ich in meinem Vortrag über KI angesprochen habe. Ich erlaube mir hier einmal den Link zu dieser Stelle in meinem Vortrag:

Karl

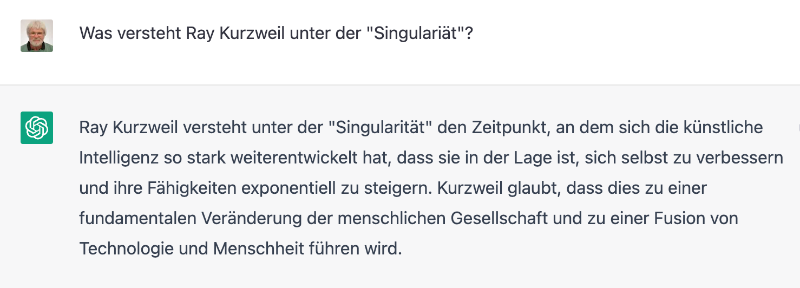

P.S.: Was sagt ChatGPT zu diesem Thema?

Danke, lieber Karl, ich hatte an die Singularität in Zusammenhang mit der Kosmologie gedacht, Schwarze Löcher, Hawking usw.

LG

DW

Bei der Mathe-Aufgabe macht die KI drei Fehler:

1. Sie erkennt nicht, dass "zufällig" und "gelegt" sich ausschließen.

2. Sie führt den Begriff " auswählen " ein. Das steht aber nicht in der Aufgabenstellung.

3. Sie liest nicht, dass dort " unterschiedliche Boxen" und " verschiedene Bälle" steht.

Und bedenkt deshalb nicht, dass es auch eine Box geben kann, in der nur ein Ball

hinein passt. Dann wären es nicht vier, sondern nur drei Boxen und die Rechnung

würde sich anders gestalten.

@Karl , danke für deine Antworten

noch eine Frage:

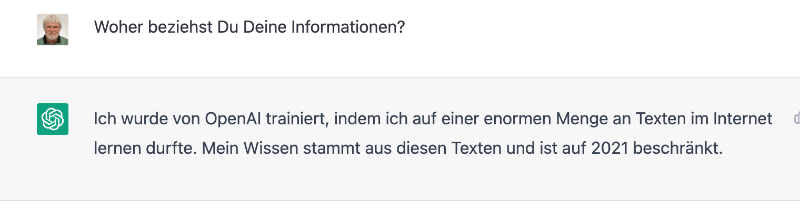

Welche Auskunft gibt chatGPT, wenn du es nach einer Frage, darüber befragst, woher es seine Informationen hat?

oder falls das nicht möglich ist: Welche Auskunft gibt chatGPT ganz allgemein, wenn du es fragst, welche Quellen es benutzt?

WurzelFluegel

wie erwartet, sehr, sehr allgemein die Antwort - aber immerhin eine Jahreszahl

vielen Dank fürs testen @Karl

WurzelFluegel

Bin heute wider Erwarten in Kontakt gekommen mit der KI.

Habe ihr eine Mathe-Aufgabe gestellt:

Eine Tasse und ein Legostein kosten zusammen 1,10 Euro.

Die Tasse ist 1,00 Euro teurer als der Legostein.

Wieviel kostet der Legostein?

Diese KI stellte die selbe Gleichung auf, die auch ich vor geraumer

Zeit aufgestellt habe:

x+(x+1)=1,10

2x+1=1,10

2x=0,10

x=0,05

Der Legostein kostet 0,05 Euro.

Unverschämt!

Na warte, ich werde es dir zeigen!!!

Anna

Trotz aller Bedenken, die sicherlich berechtigt sind, beeindruckt mich

bislang die Fähigkeit dieser KI im Bereich Mathematik.

Mag für die meisten hier uninteressant sein, für mich ist es erstaunlich.

Im Mathe-Forum haben alle, die mitgemacht haben, die gestellte Aufgabe

mit einer Gleichung gelöst.

Nur einer schrieb, dass er noch nicht einmal einen Stift in die Hand genommen hat.

Er hat nur gedacht: 1 Euro geht zu der Tasse. Übrig bleiben 0,10 Euro. Die

müssen durch zwei geteilt werden. Also: Tasse kostet1,05 Euro, Legostein 0,05 Euro.

Wir waren beeindruckt.

Heute morgen habe ich der KI die Anweisung gegeben: Löse die Aufgabe, ohne

eine mathematische Gleichung zu verwenden.

Sie hat es hinbekommen.

Der Text dazu war zwar sehr lang, mit mehr Überlegungen. Aber es war

richtig.

Ich weiß gar nicht, wie ich es sagen soll?

Ich finde es klasse, aber in mir ist auch ein gewisses Entsetzen.

Ich werde da auf dem Gebiet der Mathematik mal weiter machen.

Ich weiß auch noch nicht genau, warum ich es leicht gruselig finde????

Anna

Und schon geht es los, ChatGPT bekommt Konkurrenz.

Google startet am Montag ein eigenes Sprachmodell "Bard" was mit künstlicher Intelligenz arbeitet vor.

Ich könnte mir vorstellen dass "Bard" besonders für Google - User später in ihrem Paket mit integriert wird. Phil.

QUELLE FAZ

ChatGPT bekommt Konkurrenz. Der Internetkonzern Google kündigte am Montag den Start seines eigenen Sprachmodells an, das mit Künstlicher Intelligenz (KI) arbeitet. Es soll den Namen „Bard“ haben. Der Google-Vorstandsvorsitzende Sundar Pichai schreibt in einem Blogeintrag, die Software solle unmittelbar für eine Gruppe von Testern verfügbar gemacht werden – und dann in den kommenden Wochen für eine breitere Öffentlichkeit.

KI bzw. Chat GPT neutral?

Das kann schon deshalb nicht stimmen weil Computer von Menschen programmiert werden, die sind nie neutral. Eine reine Illusion ist das, der man nicht aufsitzen sollte.

Hier ein interessanter Artikel dazu: Warum Maschinen sexistisch sind und schlecht abstrahieren können

Zitat:

"Eine weitere große Baustelle liegt darin, dass künstliche Intelligenz in vielen Fällen diskriminierende Entscheidungen trifft, problematische Vorurteile reproduziert oder schlichtweg nicht funktioniert. Lange Zeit taten sich Bildsysteme etwa mit Personen schwarzer Hautfarbe schwer. Abgesehen davon, dass die Gesichtserkennung zum Entsperren von Handys schlechter funktionierte, führte der Einsatz durch Polizeibehörden wiederholt zu fälschlicherweise Beschuldigten. Der Hintergrund: Die Systeme wurden lange Zeit überproportional mit Fotos weißer Personen trainiert und funktionierten deshalb bei Schwarzen weniger präzise.

Neben Trainingsdaten, die einseitig sein können, fließen unbewusst oder bewusst aber auch die Annahmen von Entwicklerinnen und Entwicklern in die Algorithmen ein. Dies sorgt erst recht wieder dafür, dass die als objektiv erscheinenden Maschinen vom Start weg eine programmierte Schieflage aufweisen. "Die Welt und unsere Gesellschaft sind von Ungleichheit geprägt, wie sollen da die Daten für eine künstliche Intelligenz völlig objektiv sein. Das ist utopisch", erklärt Miriam Fahimi, die am Digital Age Research Center der Universität Klagenfurt zum Thema "faire Algorithmen" forscht.

Männer in Bewerbung vorziehen

Wenn ein System auf Basis vergangener Einstellungspolitik lerne, dass Männer in technischen Positionen in Bewerbungsgesprächen vorgezogen werden, werde es die Ungleichheit fortschreiben. Ähnliches gelte für Wohngegenden, die eine hohe Kriminalität aufweisen. Orte seien eine nur scheinbar neutrale Variable. Sie würden indirekt aber auch den sozioökonomischen Status und andere Faktoren abbilden."

Warum Maschinen sexistisch sind und schlecht abstrahieren können

Danke @

Danke @